Digital Image Processing - Introduction(chapter1)

21 Aug 2019 | Digital Image Processing대학원 진학전 목표중 하나인 곤잘레스가 주 저자인 유명한 디지털 영상처리 책을 살펴보면서 정리해보려고한다.

Chapter1(Introduction)에서 디지털 영상처리의 여러 역사가 나오지만, 역사 그 자체보다는, 1단원에서 소개되는 개념들 중 중요다고 생각되는 개념들에 대해서만 짚고 넘어가려고 한다.

이번 장에서 약간의 과학적인 내용이 나온다. 아는 선에서 정확하게 설명하려고 하지만, 다소 잘못된 사실이 있을 수 있으므로, 내용을 찾아보면서 글을 읽거나, 잘못된 부분이 보이면 지적을 부탁드립니다.

사물의 색을 인지하는 과정(Process of recognizing objects)

우리는 실제로 어떤 원리로 내 앞에 보이는 것들을 볼까? 바로 빛을 통해서 사물을 볼 수 있게된다. 중학교 시절의 과학 시간, 과학 다큐멘터리 등 다양한 곳에서 우리가 빛을 통해서 사물을 눈으로 본다는 것을 배운적이 있을 것이다.

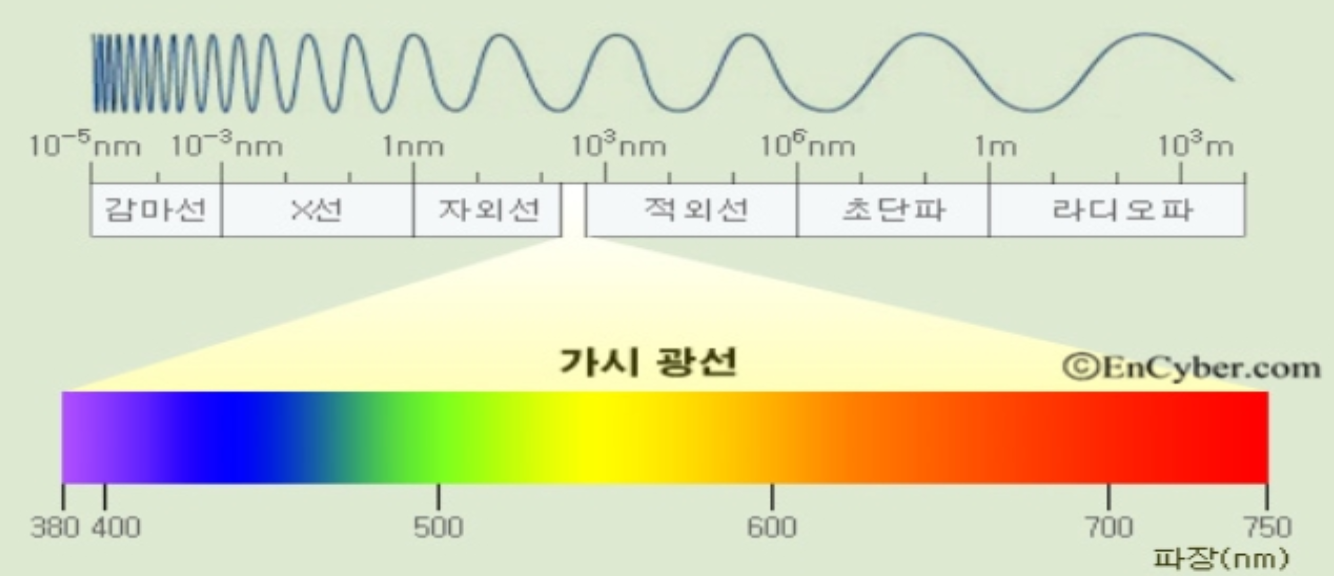

사람은 흔히 가시광선 대역의 빛을 인지할 수 있다고 한다. 그렇다면 가시광선이란 무엇일까?

바로 위 그림에 해당하는 영역($380nm<=$주파수$<=750$)의 빛을 가시광선 이라고 한다.

여기서 잠깐 에너지에 대해서 잠깐 언급하려고 한다. 에너지가 많다, 높다고하면 어떤 느낌이 오는지 말해보자. 뭔가 굉장히 가지고 있는게 많고, 힘이 셀거 같고, 빠를거 같은 느낌이 들었을 것이다. 그렇다면 빛의 에너지가 높다는 것은, 주파수가 높다는 것이다. 반대로 에너지가 낮은 빛은 주파수가 낮을 것이다.

즉 위에서 보면, 빛의 파장이 짧아질수록(주파수가 높을수록) 에너지가 높은 빛이되고, 반대의 경우 에너지가 낮은 빛이 되는 것이다. 이는 가시광선 안 에서도 에너지영역이 나뉘며, 에너지가 높을수록 보라색에 가까운 빛을 띄고, 에너지가 낮을수록 빨간색에 가까운 빛을 띈다.

그렇다면 이 얘기를 왜 했을까? 바로 에너지영역에 따라서, 빛의 색이 달라진다는 얘기를 하기 위해서이다. 이제 이 사실을 머리속에 담고, 계속해서 글을 읽어나가보자.

계속, 우리가 사물을 어떻게 보는가에 대해서 얘기를 하고 있다. 위에서 빛이 가지고 있는 에너지에 따라서 빛의 색이 달라 진다는 것을 알았다. 그게 우리가 사물을 보는것과 어떤 상관이 있을까? 햇빛은 백색광으로써, 가시광선 영역의 에너지를 연속적으로 가지고 있는 빛이다. 이 백색광이 사물에 부딪히게 되면, 특정 에너지 구간에 속하는 에너지만 남겨두고 나머지 영역의 에너지는 사물에 흡수되버린다. 그리고 물체는 흡수하지 않은 영역의 에너지를 빛의 형태로 내보내고, 우리는 그 영역의 빛을 우리 눈의 시신경으로 받아들이고, 그 물체의 색을 인지하게되는 것이다.

즉, 빨간색 사과가 있다고하면, 빨간색 영역의 빛만 남겨두고 나머지 영역의 빛을 흡수해버리고, 빨간색 영역의 에너지를 빛으로 내보내어 우리 눈에서 사과를 빨간색으로 인식하는 것이다. 특정 영역의 빛만 흡수하거나 반사하는 것은 에너지가 양자화 되어있기 때문이다. (즉, 사물에 부딪히는 빛의 에너지가 아무리 높더라도, 특정 영역의 에너지만 흡수하거나 반사하는 것)

이러한 원리로 우리는 색을 인지할 수 있게된다. 사실, 우리가 공간적인 정보를 느끼는것, 조도를 느끼는것 등 우리가 사물을 보는 원리에 대해 설명하려면 정말 많은 것들을 설명해야 할 것이다. 이렇듯, 우리가 사물을 눈으로 인식하기 위해서는 아주 다양한 과학적 설명이 동반되야 하지만, 결론적으로 빛을 통해서 사물을 본다는 사실을 기억하자.

빛(Light)

빛은 300000km/s의 속도를 지니고 있으며, 파동과 입자의 성질을 모두 지니고 있다. 여기서 빛은 파동이라는 점에 주목하자.

위에서 언급한것과 같이, 빛의 에너지와 주파수는 상당한 관련이 있다. (내용을 이어나가기 전, 주파수와 파장은 반비례관계 라는 것을 알고가자)

주파수가 높을수록, 빛이 지닌 에너지가 높고, 주파수가 낮을수록, 빛이 지닌 에너지가 낮다. 그렇다면, 주파수와 파장은 반비례 하므로,

주파수가 높을수록(파장이 짧을수록), 빛이지닌 에너지가 높고, 주파수가 낮을수록(파장이 길수록), 빛이지닌 에너지가 낮다고 할 수 있다.

에너지가 높은 빛은, 직선적이며, 투과력이 높고, 멀리가지 못하고, 회절현상이 잘 일어나지 않는다.

여기서 회절현상은 빛이 진행하다가 다른 물체에의해 가로막혔을때, 우회해서 지나가는 능력이라고 이해해두자.

반대로, 에너지가 낮은 빛은, 덜 직선적이며, 투과력이 낮고, 멀리 진행할 수 있으며, 회절현상이 잘 일어난다.

이러한 빛의 성질때문에, 우리가 기계를 통해서 영상을 얻고자 할 때, 사용하는 빛의 파장(또는 주파수)이 달라진다.

X-ray영상을 얻기 위해서는, 우리 몸을 투과해야 하므로, 투과성이 높은 영역의 빛이 사용되며, 파장이 긴 적외선 영역의 빛은 도시, 지역 등 전체적은 구조를 관찰하는 곳에 쓰인다.

하지만, 꼭 다양한 영역의 빛의 특징을 다음과 같이 보아서, 빛의 용도를 위와 같이 한정해서 분류할 수 있는것이 아니며, 빛의 성질과, 분석하려는 물체의 성질에 따라서 사용하는 빛의 주파수 영역대와 관측 방식이 달라진다는 것을 알아두자.

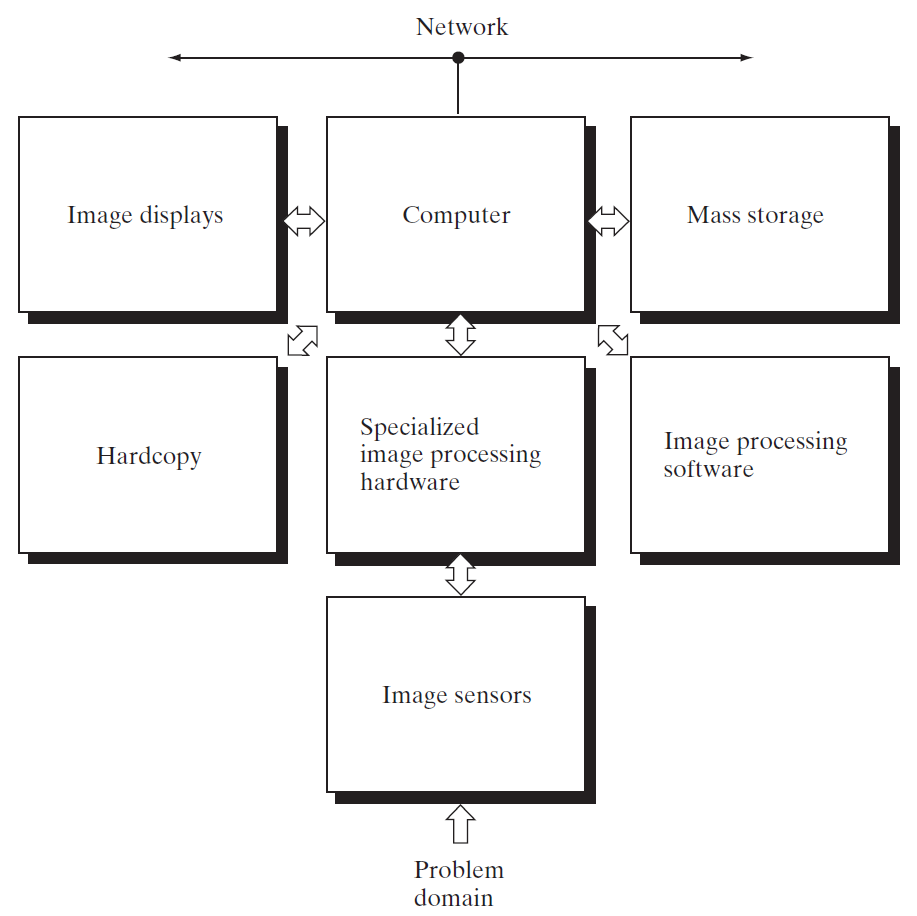

범용 영상 처리 시스템의 구성요소(Components of a general-purpose image processing system)

위 그림은 위 책에 실려있는 그림이다. 영상처리 시스템은 위와 같이 일반적으로 구성되어 있다고 설명되어있다. 영상 센서를 통해서, 빛을 받아들이고, 양상 처리 하드웨어로, 받아들인 빛을 디지털 신호로 전환하며, 영상 처리 소프트웨어를 통해서 우리가 원하는 목적에 맞게 영상을 변환시키고, 기타 장치에 영상을 저장하거나, 보여준다.

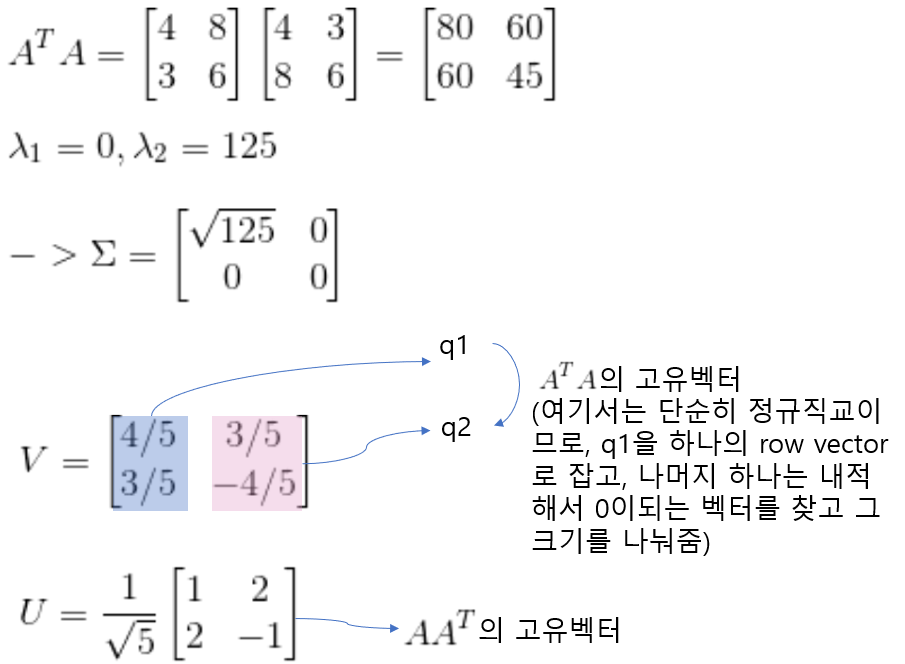

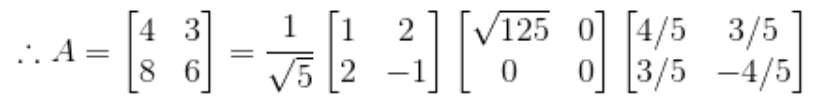

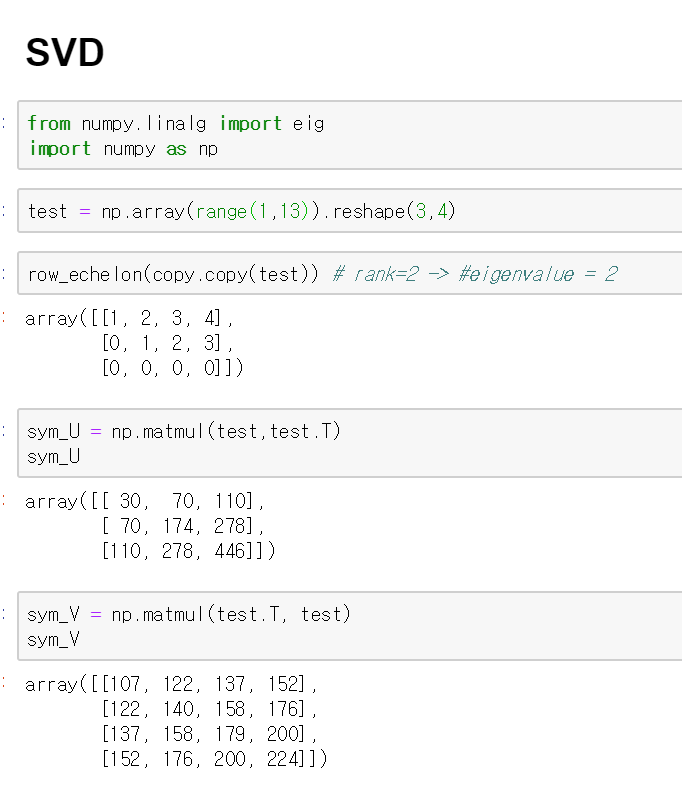

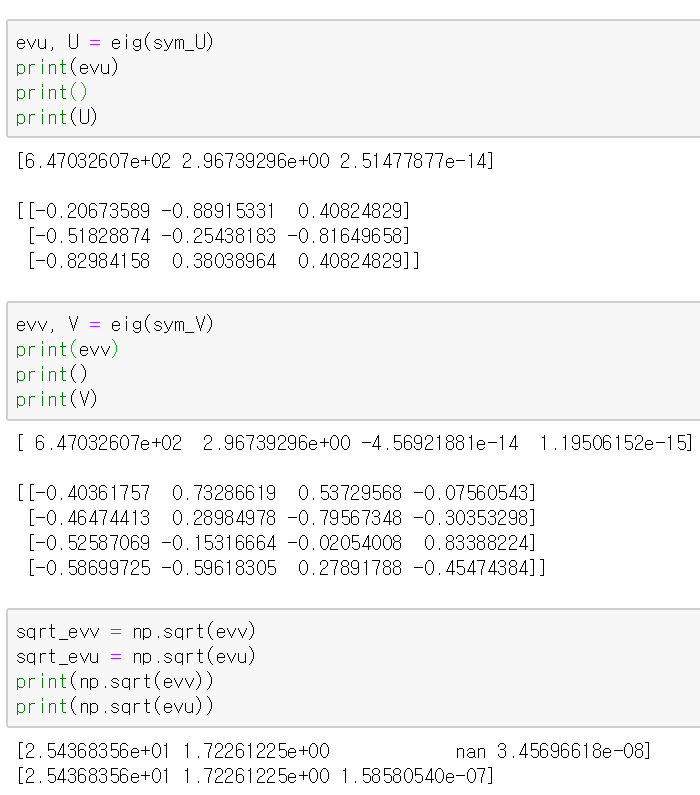

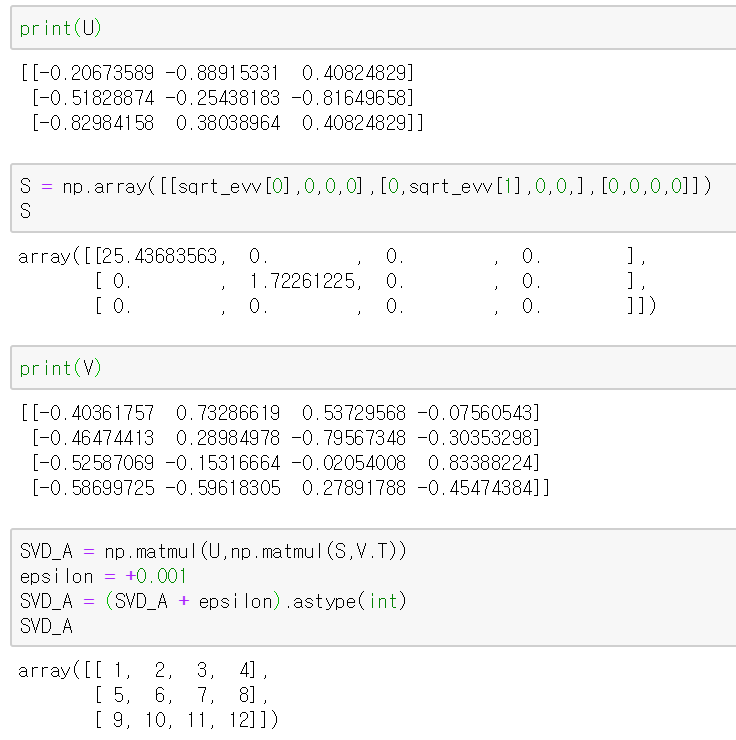

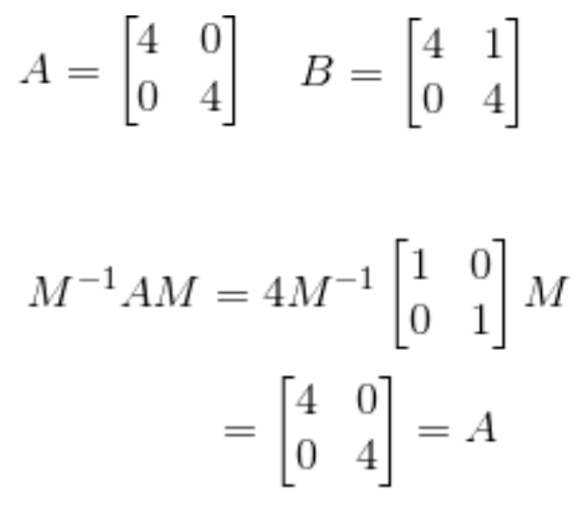

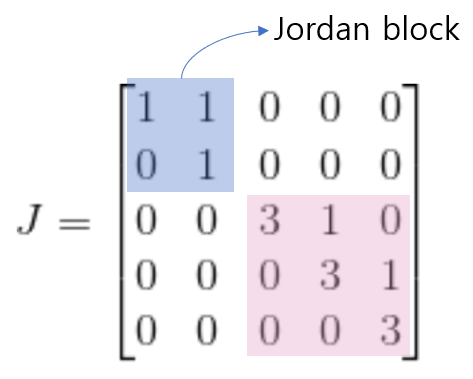

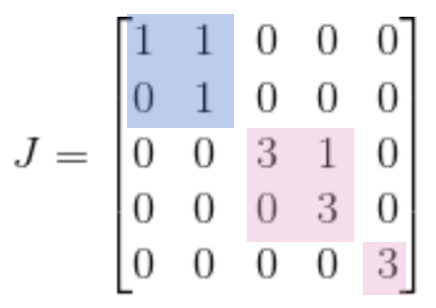

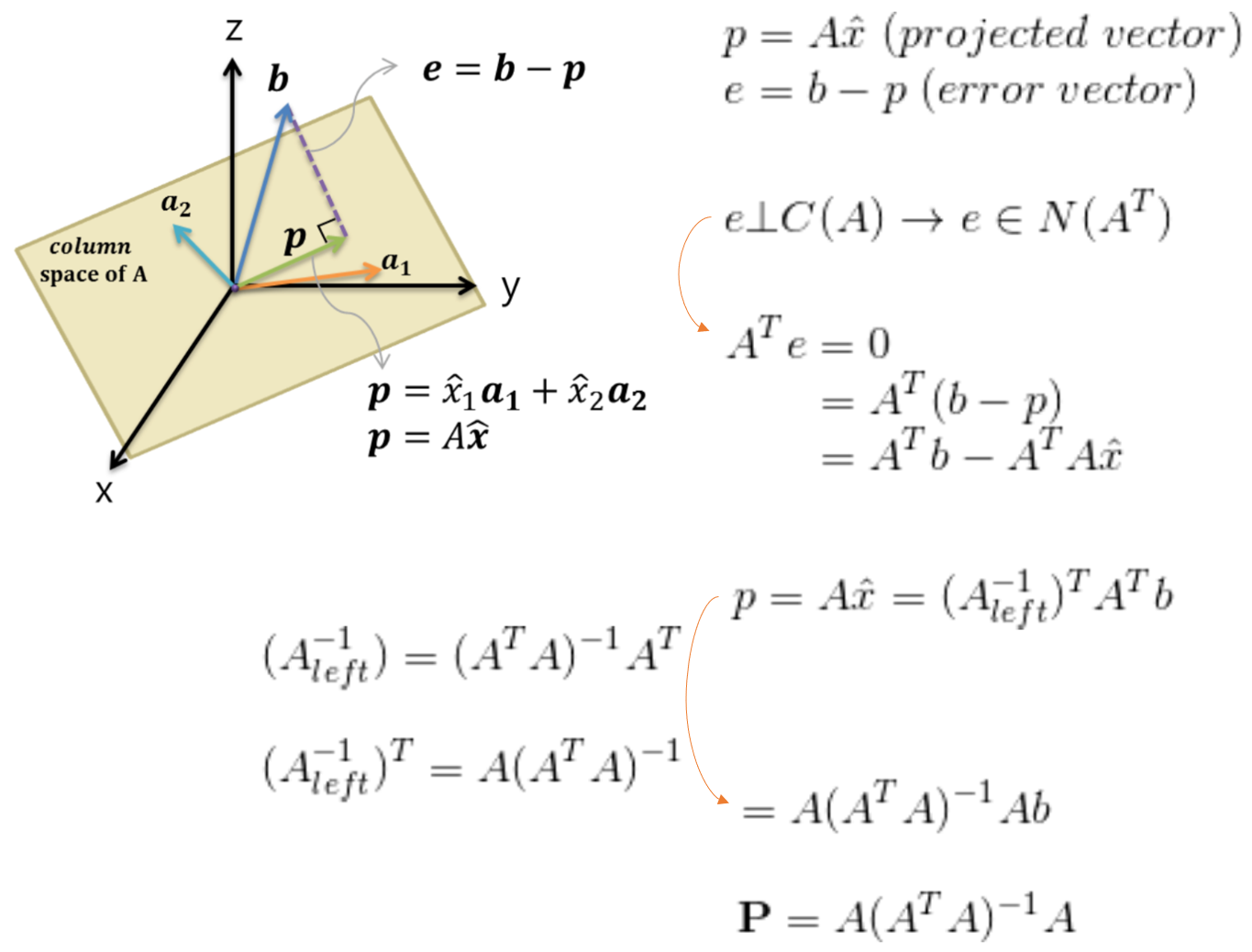

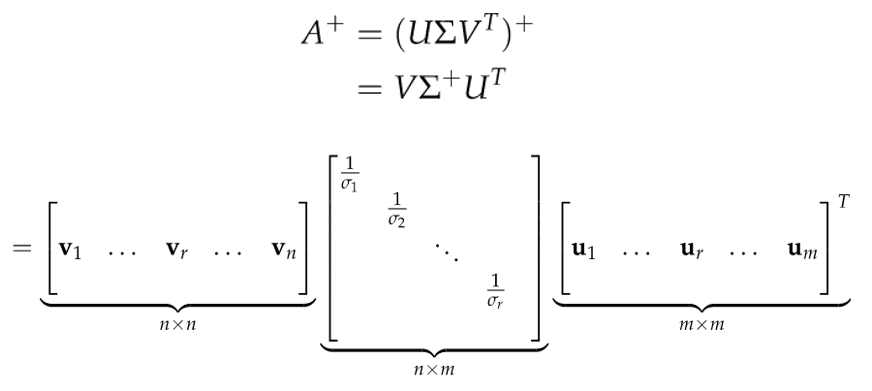

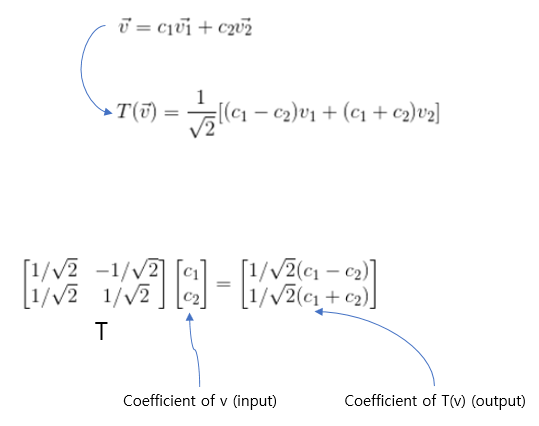

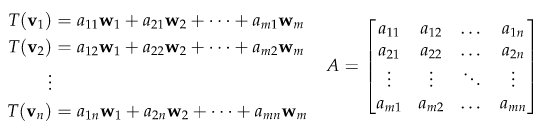

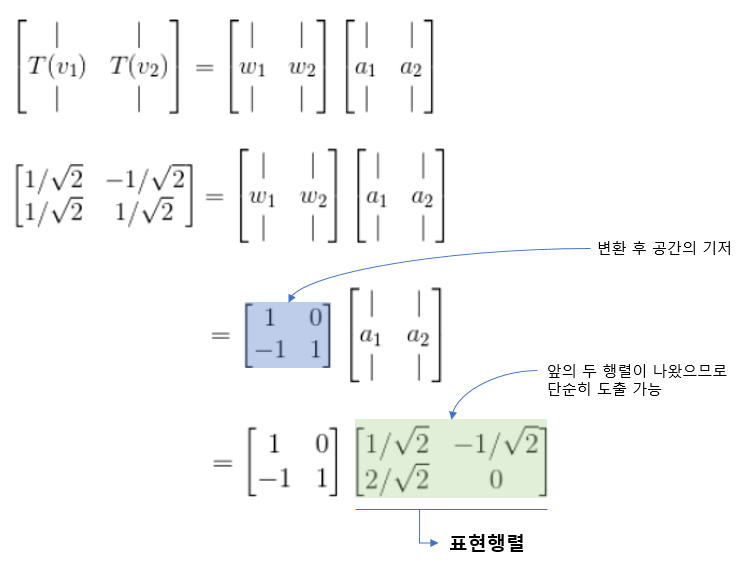

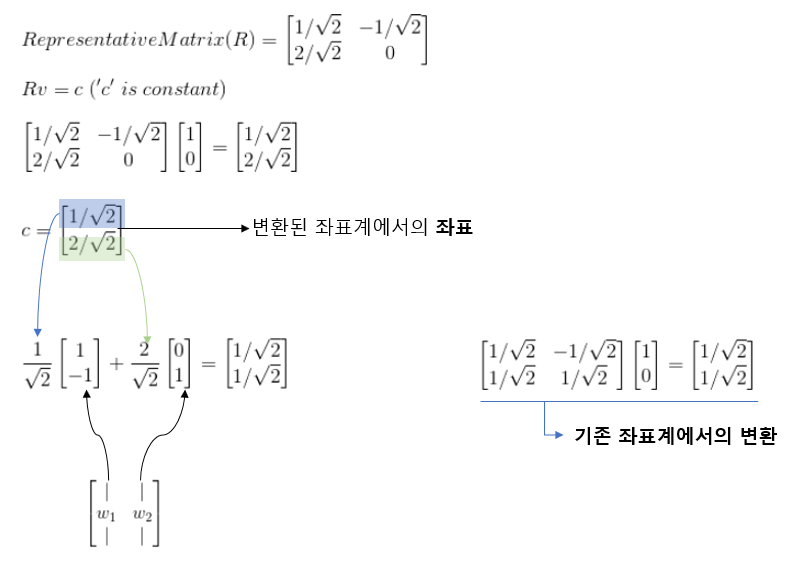

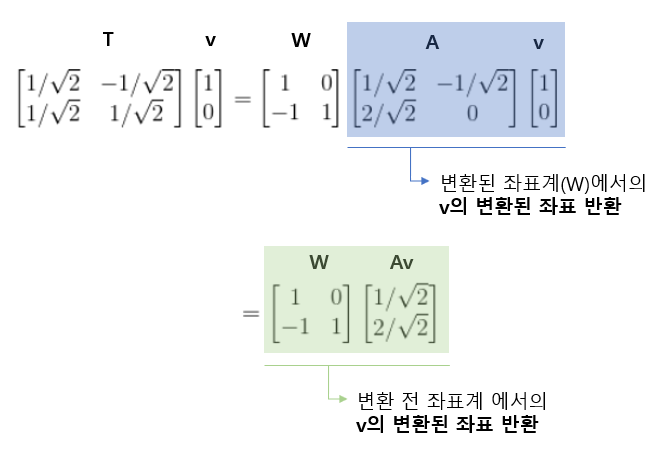

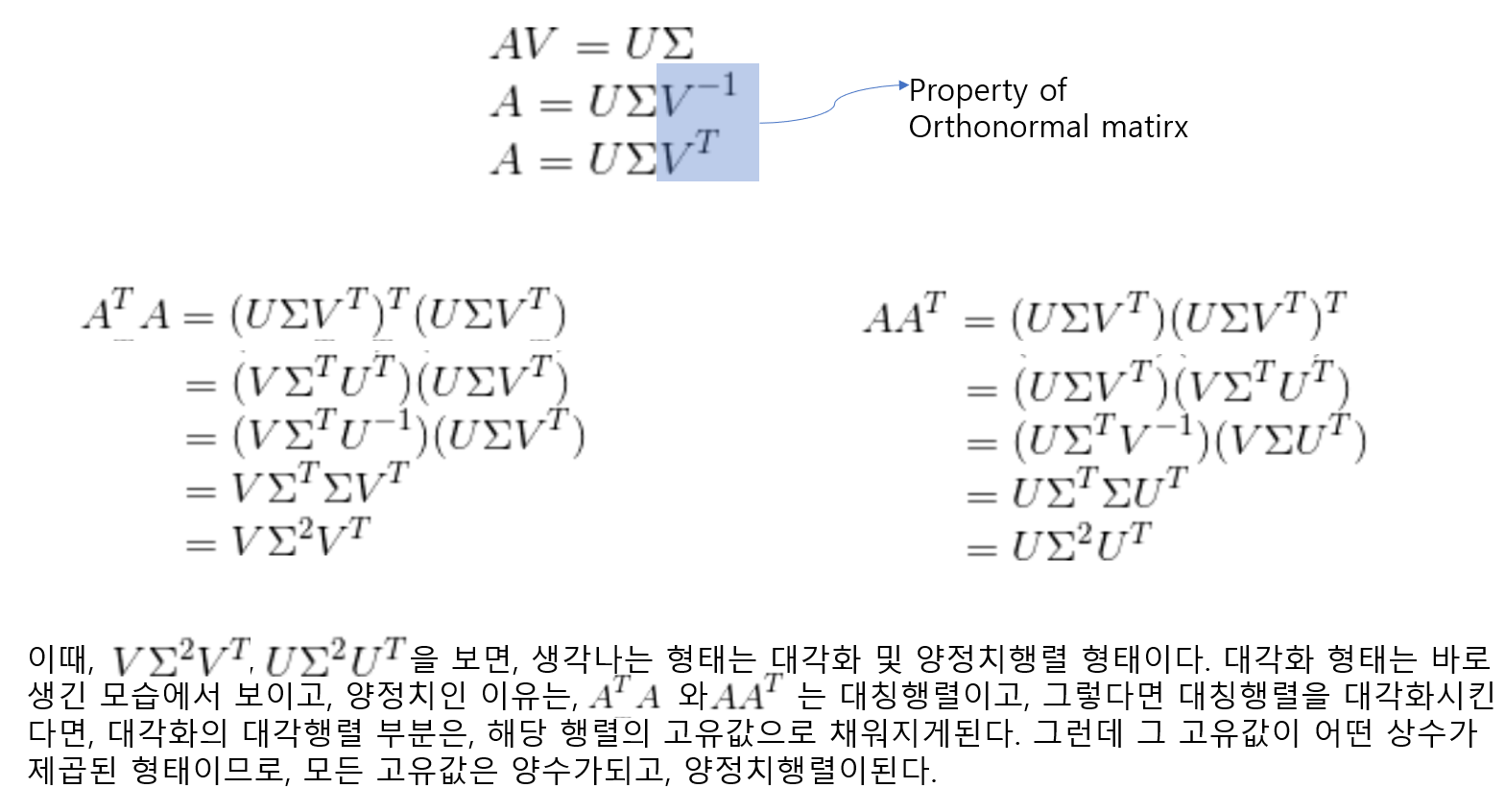

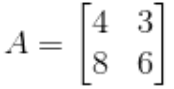

그리고 위 행렬 A는 다음과 같이 표현될 수 있다.

그리고 위 행렬 A는 다음과 같이 표현될 수 있다.